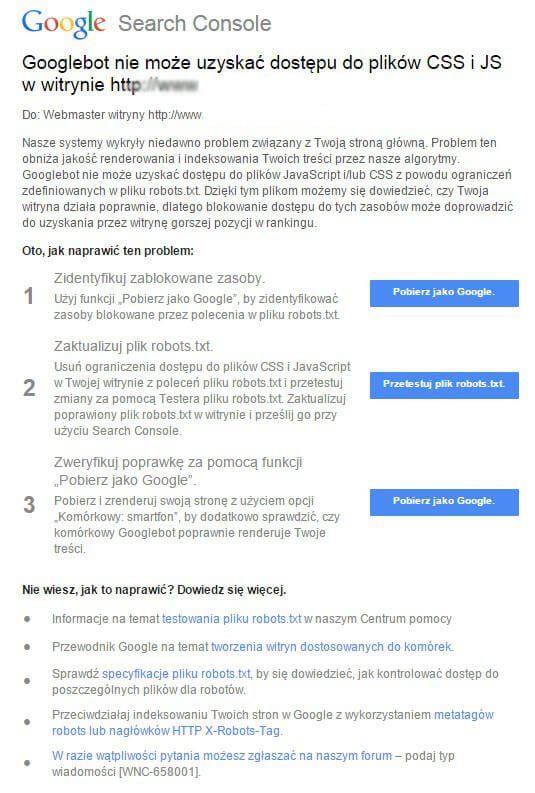

W wiadomości można przeczytać:

Nasze systemy wykryły niedawno problem związany z Twoją stroną główną. Problem ten obniża jakość renderowania i indeksowania Twoich treści przez nasze algorytmy. Googlebot nie może uzyskać dostępu do plików JavaScript i/lub CSS z powodu ograniczeń zdefiniowanych w pliku robots.txt. Dzięki tym plikom możemy się dowiedzieć, czy Twoja witryna działa poprawnie, dlatego blokowanie dostępu do tych zasobów może doprowadzić do uzyskania przez witrynę gorszej pozycji w rankingu.

W Google Console można sprawdzić, które dokładnie arkusze stylów oraz skrypty są blokowane w pliku robots.txt i zastosować odpowiednie korekty. Aby poprawić powyższe błedy należy zalogować się do konsoli, przejść do sekcji indeksowanie -> Pobierz jako Google i kliknąć przycisk pobierz i zrenderuj. Nastąpi wtedy próba pobrania strony głównej. Po dłuższej chwili wyświetli się komunikat o zakończeniu tego procesu i można przejść do analizy problemów.

Zrenderowana strona oraz wykaz zasobów, między innymi również te, które są blokowane podane są w czytelnej tabelce. Wtedy dokładnie webmaster wie, jakie poprawki należy wprowadzić do pliku robots.txt, aby roboty google nie miały problemów z poprawnym pobieraniu zawartości naszej witryny.

Więcej informacji można znaleźć w pomocach Google tutaj oraz w celu tworzenia bardziej skomplikowanych reguł pomocna będzie specyfikacja pliku robots.txt – tutaj.